ディープラーニングの仕組みをわかりやすく解説丨音声認識との関連は?|トラムシステム

コンタクトセンターやコールセンターなど様々な業界で注目されている音声認識技術ですが、その根幹をなすのがディープラーニングです。従来の人工知能より学習効率や精度が格段に向上しているのが特徴で、音声認識だけでなく、自然言語処理や画像認識などあらゆる部分で導入が進んでいます。

本記事では、ディープラーニングの仕組み、特徴、音声認識との関連性についてわかりやすく解説します。

目次

ディープラーニングとは

ディープラーニングとは、人の脳神経を模倣したニューラルネットワークを活用し開発されたAIアルゴリズムで、現在の人工知能の代表的存在と言える技術です。学習する際、データのどの部分に着目するか人間が指定していた「特徴量」を自ら発見することが可能で、音声や動画といった数値化が難しい非定型データまで分析対象にできます。

2012年の画像認識コンペティションで圧倒的な性能を見せ優勝した「Super Vision」をきっかけに注目されるようになり、2045年にはAIが人間の能力を上回る「シンギュラリティ」が起きる」とまで言われました。現在では多くの国際機関や施設で研究が行われており、自動運転やチャットボットといった人間を代替するサービスの導入が進んでいます。

AI・機械学習との違い

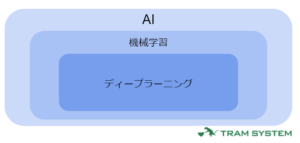

人工知能はこれまで「AI」や「機械学習」と呼ばれてきましたが、ディープラーニングも含めそれぞれ意味合いが微妙に異なります。まずはそれぞれを区別を付けられるようになりましょう。

・AI

機械に人間の知能を持たせることを目的とする技術や研究のこと。人工知能とも呼ばれます。1950年代にはすでに提唱されており、いくつかの冬の時代を乗り越え、さまざまな技術や概念が研究されてきました。機械学習とディープラーニングもAIの一種です。

・機械学習

人工知能にデータを学習させる手法の1つで「Machine Learning」とも呼ばれます。人工知能が自律的に学習してデータのパターンを発見し、分析や予測を行うのが特徴です。ただし先ほど説明した「特徴量」の指定は人間が行う必要があり、画像や音声といった非定型データの分析が難しいという弱点が存在していました。

・ディープラーニング

特徴量の問題を解決した人工知能がディープラーニングです。ディープラーニングも機械学習を利用しているため「人工知能の一種として機械学習が、機械学習の一種としてディープラーニングが存在している」と覚えましょう。特徴量を自動で抽出することができるため、人工知能にデータを学習させる際の精度が大幅に向上し、数字で表せない非定型データの分析も可能となりました。

ディープラーニングの仕組み

ディープラーニングを一言で解説するなら「ニューラルネットワークを多層に重ねてラーニングを行うアルゴリズム」となります。まさに「ディープ(深い)」なラーニングです。

ニューラルネットワークとは何か、なぜディープラーニングがニューラルネットワークを多層にする必要があるのか見ていきましょう。

ニューラルネットワークとは

人間の脳機能を構成するのは、神経細胞ニューロンと、ニューロン同士を接続する神経回路網シナプスです。ニューロンはシナプスを使い、別のニューロンに電気信号による情報伝達を行うことで、脳の思考や判断を決定させています。

ニューラルネットワークではこのニューロンをノード、シナプスをエッジとして再現しますが、ノード同士を連結するエッジは、1つ1つ情報の伝達しやすさが違うのが特徴です。

例えばAさんが「遊園地に行くか行かないか」を判断する時に「天気がどうなっているか」「誘っていた友達が来てくれるか」という2つの判断基準があるとします。

天気はあいにくの雨でしたが、 Aさんは友達が来てくれるため「遊園地に行く」と判断しました。つまり「天気がどうなっているか」より「誘っていた友達が来てくれるか」の方が重要度が高かったため、行くことにしたのです。

このように、なんらかの思考や判断を導き出すために必要な情報の重要度は1つ1つ違っており、これをニューラルネットワークでは「重み」と呼びます。エッジに設定された重みをそれぞれ調節することで、ニューラルネットワークはより人間に近い思考が可能なのです。

人間のような思考を再現するため、ニューラルネットワークはノードと重みがそれぞれ違うエッジを入力層、隠れ層、出力層の3層構造にし、データの学習や分析を行っています。

・入力層

分析や判断に必要なデータを入力するノードです。先程の例では「天気がどうなっているか」「誘っていた友達が来てくれるか」の2つが該当します。

・隠れ層

エッジを通じて調節された入力層の情報を受け取り、分析を行うノードです。例の場合は「天気は雨だけどさほど嫌ではない」「誘ってくれる友達が来てくれるから行こう」といった判断を出力層に返します。

・出力層

隠れ層からの情報をもとに判断や分析を出力するノードです。例では最終的に「遊園地に行く」という判断を出力するはずですが、もし「遊園地に行かない」といった想定と違う判断を下した場合は再設計が必要となります。

ディープラーニングが「ディープ(深い)」理由

ニューラルネットワークの隠れ層の層を増やす、すなわち多層にしてよりディープな判断や思考を可能としたのがディープラーニングです。隠れ層は導き出したい情報に応じて自由にデザインできるため、より実用的なシステムを構築可能となります。

一見単純かつ効果的な手法に見えますが、理論通りに再現できることが難しく研究は下火でした。なぜなら、隠れ層を多層すればするほど学習速度が低下する「勾配消失問題」という課題が存在してたからです。

これは、ニューラルネットワークの計算方法である「誤差逆伝播法」が原因でした。

誤差逆伝播法はランダムに決めた重みを元に計算を繰り返し、予測と正解の誤差を利用して学習を進める手法です。ですが、隠れ層を重ねると計算量が膨大となり、うまく学習できなくなる「勾配消失」が発生します。これにより長年隠れ層を多層に出来なかったため、他の手法より性能が向上しませんでした。

この「勾配消失問題」を解決するため2006年に発表された技術を「オートエンコーダ」と呼びます。入力層のデータを隠れ層で圧縮して重要な特徴量を抽出した後、再度元の次元に復元処理する技術です。

特徴量を抽出できるだけでなく、ランダムに決めていた重みを事前に学習するため、勾配消失を防ぐこともできます。これにより、ようやく隠れ層をディープに重ねるディープラーニング実現の目途が立ちました。ただし、技術の発展によりオートエンコーダそのものは現在利用されておらず、派生技術を用いるのが一般的です。

ディープラーニングの学習方法

ディープラーニング自体にも複数の学習方法が存在しており、用途に応じて使い分けられています。それぞれニューラルネットワークの構造が異なり、活用できる分野も違うため、業務で利用する際は注意が必要です。

CNN(畳み込みニューラルネットワーク)

画像認識の分野で活躍するニューラルネットワークで、物体検出や領域推定に用いられています。入力された画像を画素の大きさまで切り取り特徴量を抽出する「畳み込み層」と、特徴量を圧縮して不要な部分をさらにそげ落とす「ブーリング層」で構成されており、この2つの処理を繰り返すことで画像認識を行う仕組みです。

RNN(再帰型ニューラルネットワーク)

言葉の意味を認識する自然言語処理の分野で活用されているニューラルネットワークです。文脈を読み取るのに必要な時系列情報を認識できる「自己回帰型」の構造が特徴で、機械翻訳や音声認識でも欠かせない技術です。ただし、時系列が長くなると情報が上手く伝達されないという弱点も存在します。

LSTM(Long Short Term Memory)

RNNの発展形で、ある程度長い時系列データも学習できるよう改良されたニューラルネットワークです。学習状況を保存する「メモリセル」や不要と思われる情報を消去する「忘却ゲート」が備わっており、重要なデータのみ残しつつ効率よく学習できます。「Google翻訳」やスマートスピーカー「アレクサ」にも搭載されている技術です。

GAN(敵対的生成ネットワーク)

画像を生成する際に用いられるニューラルネットワークで、画像データを出力する「生成器」と画像が本物かどうかを識別する「識別器」で構成されています。互いは文字通り敵対関係にあり、生成器はより本物に近い画像を生成し、識別器はより正確に画像の真偽を判別して、互いの精度を高めていくのが特徴です。本物の人物そっくりの画像を生成する「ディープフェイク」やテキストデータを用いた画像生成に用いられます。

ディープラーニングと音声認識

最後に、コールセンターやコンタクトセンター業務で関連性が高い音声認識技術について解説します。

音声認識とは、音声データをテキストデータに変換する技術です。長年研究が続けられていましたが、ディープラーニングの登場によって精度が飛躍的に向上しました。入力された音声データを認識しやすいデータに変換する「音響分析」から、単語を文章化する「言語モデル」に至る作業を1つのニューラルネットワークモデルで実現可能となり、膨大な情報量を処理して特徴量を抽出できるからです。

コールセンターでは、以下のような用途で音声認識が用いられています。

1.文字起こし

人間の手で行われていた録音データの文字起こしを自動で行う技術です。オペレーターの作業負担を軽減するだけでなく、テキスト化することでデータとしての分析が容易となります。

2.感情分析

顧客の音声から感情にまつわる特徴量を抽出し、感情をデータ化する技術です。応対中の顧客がどのような感情を抱いているかが分かるようになり、品質向上やコミュニケーションの研究を行えます。

3.問題発見

オペレーターの応対をリアルタイムでテキスト化し、要注意ワードを検出する技術です。これまでSV(スーパーバイザー)が人力で行っていたモニタリングの負担を軽減し、問題発生の見逃しを防ぎます。

まとめ

ディープラーニングは今後の企業経営において重要な存在となるため、情報技術者でない方も仕組みを理解しておく必要があります。コールセンターでの業務を行う方は、特に音声認識に関する知見を深めておきましょう。弊社でも音声認識に関するソリューションを提供していますので、興味のある方はぜひお問い合わせください。

WRITER

トラムシステム(株)メディア編集担当 鈴木康人

広告代理店にて、雑誌の編集、広告の営業、TV番組の制作、イベントの企画/運営と多岐に携わり、2017年よりトラムシステムに加わる。現在は、通信/音声は一からとなるが、だからこそ「よくわからない」の気持ちを理解して記事執筆を行う。